【導(dǎo)讀】一家成立由20名員工組成的日本新創(chuàng)公司ITD Lab正在開發(fā)一種“智能立體攝像頭”(Intelligent Stereo Camera,ISC)技術(shù),鎖定包括先進(jìn)駕駛輔助系統(tǒng)(ADAS)、自動駕駛車輛、無人機(jī)、建筑用工具機(jī)、工業(yè)用機(jī)器人等應(yīng)用。

ITD Lab的秘密武器是首席技術(shù)官実吉敬二(Keiji Saneyoshi),他是日本車廠斯巴魯(Subaru)智能駕駛輔助系統(tǒng)EyeSight之父,是該車廠原創(chuàng)立體視覺系統(tǒng)“Stereo Range Imager”幕后的首席工程師;実吉任職于Subaru時(shí)率領(lǐng)的團(tuán)隊(duì),開發(fā)了第一套只利用立體攝像頭(stereo cameras)來偵測物體,例如車輛、行人、自行車或機(jī)車騎士的駕駛輔助系統(tǒng)。

Keiji Saneyoshi

実吉在1998年離開Subaru進(jìn)入學(xué)界,在東京工業(yè)大學(xué)(Tokyo Institute of Technology,TIT)擔(dān)任教授直到2017年初;他在TIT任教期間指導(dǎo)的團(tuán)隊(duì)進(jìn)一步提升了原始立體視覺算法,并在2016年5月成立ITD Lab

顯然先進(jìn)的立體視覺(stereo-vision technology)技術(shù)就是実吉與ITD Lab的專長所在,該技術(shù)可提供“距離估算”(distance estimation),這是單眼攝像頭無法做到的。然而,傳感器融合在現(xiàn)今汽車產(chǎn)業(yè)領(lǐng)域蔚為風(fēng)潮,ITD Lab推動立體視覺在ADAS的應(yīng)用似乎是違背直覺。

盡管立體視覺曾經(jīng)被視為ADAS來說至關(guān)重要的差異化技術(shù),聚焦于高度自動化駕駛車輛的一線汽車零組件供應(yīng)商(Tier One)與車廠傾向于認(rèn)為立體視覺不那么相關(guān);產(chǎn)業(yè)界形成的共識是,單視覺(Monovision)的局限可以透過單眼攝像頭與雷達(dá)的結(jié)合來解決。

実吉坦承,雷達(dá)-單視覺方案確有進(jìn)展,不過他仍然對ITD Lab的立體視覺技術(shù)有信心,因?yàn)樵摷夹g(shù)不需要融合雷達(dá)數(shù)據(jù),能提供在3D距離量測、自我位置識別、防碰撞、物體追蹤、車道識別、道路邊界識別等方面表現(xiàn)卓越性能,速度可達(dá)每秒60訊框(frames)、最高甚至可達(dá)每秒160個(gè)訊框。

曾受教于実吉的ITD Lab首席執(zhí)行官小倉明宏(Akihiro Ogura)接受EE Times采訪時(shí)表示,該公司技術(shù)的其他優(yōu)勢包括支持“自動校準(zhǔn)”(automatic calibration),能吸收制造失誤與安裝時(shí)的連接失誤;而小倉強(qiáng)調(diào),ITD Lab的技術(shù)目標(biāo)是以較低的成本提供最高安全性,該公司應(yīng)用于ADAS的解決方案之成本會低于Intel/Mobileye的方案。

ITD Lab是在一個(gè)黑盒子里提供其先進(jìn)立體視覺算法,以儲存在ROM中的程序代碼形式,用以啟動Intel-Altera的Cyclone FPGA。

ITD Lab展示其智能立體攝像頭(左上) (來源:EE Times)

與EyeSight系出同源

雖然ITD Lab是一家新創(chuàng)公司,卻因?yàn)榧夹g(shù)與Subaru的EyeSight有血緣關(guān)系而很少遇到信譽(yù)相關(guān)的問題。如技術(shù)顧問公司VSI Labs創(chuàng)辦人暨首席顧問Phil Magney所言:“EyeSight是很可靠的解決方案,而且已經(jīng)存在市場好一段時(shí)間;Subaru在推出前向(forward-facing) ADAS解決方案后不久就贏得不少贊賞,這成為Subaru車用安全解決方案陣容的基礎(chǔ)。”

以実吉在Subaru開發(fā)的Stereo Range Imager為基礎(chǔ),ITD Lab聲稱其解決方案有進(jìn)一步的改善,特別是在自動校準(zhǔn)、視差影像精確度(parallax image accuracy)、計(jì)算性能(平行處理優(yōu)化)等方面。不過也有部分產(chǎn)業(yè)觀察家指出,立體視覺不再是ADAS的唯一解答。

針對Subaru的EyeSight,市場研究機(jī)構(gòu)The Linley Group資深分析師Mike Demler的觀察是:“Subaru顯然利用了雙攝像頭進(jìn)行距離估算,以支持其適應(yīng)性巡航控制與自動剎車/油門等功能,這是罕見的選擇;”他指出:“雷達(dá)現(xiàn)在是該類功能更熱門的技術(shù)選項(xiàng),也更精確可靠,因?yàn)椴槐仡檻]光線情況與雨雪等情境。”

而Demler指出,使用立體攝像頭的唯一理由是3D建模以及距離估算,他猜測実吉選擇立體視覺方法而非攝像頭-雷達(dá)系統(tǒng),只是因?yàn)樗麑η罢弑容^熟悉。不過実吉堅(jiān)稱,立體視覺方案──藉由在整個(gè)流程中保持光流(optical flow)──能讓ADAS更簡單而且容易,因?yàn)椴恍枰獋鞲衅魅诤稀?/div>

VSI Labs的Magney部分同意実吉的意見;他指出:“采用立體視覺做為主要傳感器,就不必?fù)?dān)心雷達(dá),”而且能讓你“把所有的處理程序包進(jìn)立體視覺模塊中,所以在布署之前一切都設(shè)定妥當(dāng);”然而他也指出:“更常見的方法是將單眼攝像頭搭配雷達(dá),可以更合理地量測物體的深度以及運(yùn)動。”

確實(shí),雷達(dá)技術(shù)一直在變得更好;如Magney所言,它抵抗天氣的能力比攝像頭更好。在另一方面,雷達(dá)的最大問題仍然是“誤報(bào)”。隨著傳感器融合的勢力不斷擴(kuò)大,ITD的立體視覺技術(shù)有可能已經(jīng)過時(shí),但該公司首席執(zhí)行官小倉在充分意識到所面臨的艱困市場競爭之同時(shí),也表示:“給我們機(jī)會證明我們的技術(shù),你一定不會失望。”

支持立體視覺技術(shù),你不是一個(gè)人在戰(zhàn)斗

日本新創(chuàng)公司ITD Lab并非唯一看好立體視覺技術(shù)的業(yè)者,還有包括汽車安全系統(tǒng)制造商Autoliv、Subaru/Eyesight以及Ambarella (VisLab),也提供立體視覺解決方案。

市場研究機(jī)構(gòu)The Linley Group資深分析師Mike Demler表示,來自歐洲的自動駕駛技術(shù)開發(fā)商AIMotive曾示范過利用立體攝像頭支持高階自動駕駛;技術(shù)顧問公司VSI Labs創(chuàng)辦人暨首席顧問Phil Magney則指出,除了前面提到的那些公司:“有少數(shù)一線(Tier Ones)汽車電子廠商也仍支持立體視覺技術(shù),就算目前沒有將該技術(shù)列在產(chǎn)品列表中,也會提供立體視覺方案的詢價(jià)(RFQ)。”

相較于其他立體視覺解決方案,ITD Lab首席技術(shù)官実吉敬二(Keiji Saneyoshi)強(qiáng)調(diào),該公司的優(yōu)勢在于兩個(gè)方面:“我們提供更清晰的物體邊緣(object-edge)偵測,而且我們的處理速度快很多──大概是Subaru EyeSight速度的十倍。”

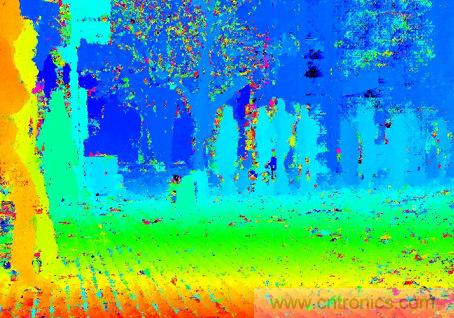

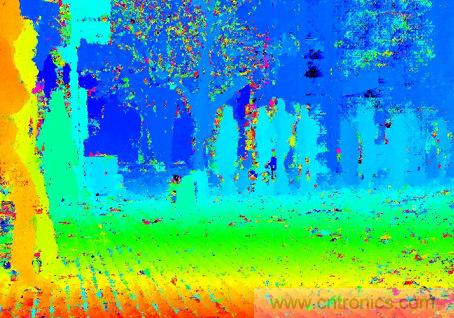

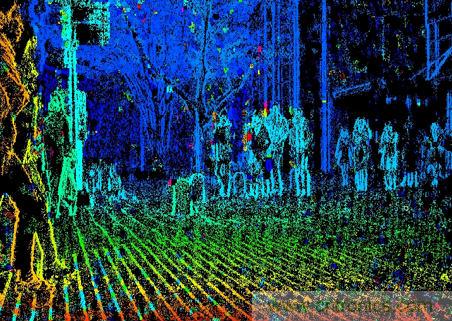

CMOS影像傳感器拍攝的影像 (來源:ITD Lab)

ITD Lab競爭對手之立體視覺技術(shù)拍攝的影像 (來源:ITD Lab)

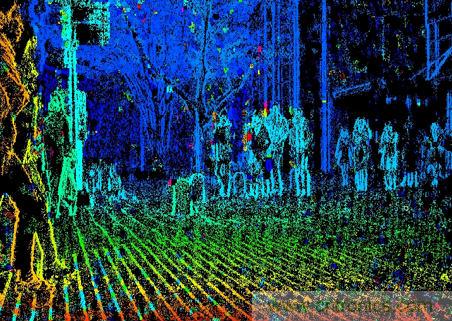

上面的第一張圖是以CMOS影像傳感器拍攝的影像,第二張圖則是ITD Lab競爭對手的立體視覺技術(shù)所擷取的影像;実吉指出,物體之間的邊緣粗糙而且模糊,可能導(dǎo)致某些物體消失在背景中。下方的影像則是由ITD Lab自家立體視覺技術(shù)拍攝的,每個(gè)物體的邊緣更銳利,強(qiáng)化了可藉由轉(zhuǎn)向避免碰撞的能力。

以ITD Lab立體視覺技術(shù)拍攝的影像 (來源:ITD Lab)

功能齊全的SoC

而ITD Lab與其他計(jì)算機(jī)視覺處理器業(yè)者的最大差異化所在,是実吉堅(jiān)持利用FPGA做為視覺加速器,他相信FPGA不只對該公司的立體視覺算法很理想,也能在未來用以執(zhí)行CNN或DNN等人工智能神經(jīng)網(wǎng)絡(luò):“FPGA的平行處理流水線是為深度學(xué)習(xí)量身打造。”

雖然目前ITD Lab的智能立體攝像頭(Intelligent Stereo Camera)還未提供深度學(xué)習(xí)功能,但該公司首席執(zhí)行官小倉明宏(Akihiro Ogura)表示,他們計(jì)劃利用“一款低成本FPGA”添加AI功能。根據(jù)ITD Lab代理商Macnica/Fuji Electronics總經(jīng)理荒井文彥(Sachihiko Asakura)的說法,該公司正準(zhǔn)備導(dǎo)入來自第三方業(yè)者的深度學(xué)習(xí)解決方案。

對此VSI Labs的Magney表示:“對ADAS來說,沒有AI功能不會是一個(gè)缺陷,因?yàn)樵擃愊到y(tǒng)主要是決定性應(yīng)用;不過對更多先進(jìn)應(yīng)用(例如自動駕駛)來說,你會需要對AI技術(shù)有所著墨,以保持與市場的關(guān)聯(lián)性。”

ITD Lab的実吉堅(jiān)信,立體視覺處理是在未進(jìn)行訓(xùn)練的情況下偵測一般物體的理想方案;相較之下單眼視覺可能會在遇到未經(jīng)過訓(xùn)練的狀況時(shí)錯(cuò)失物體偵測;“舉例來說,Volvo的自動駕駛技術(shù)據(jù)說在識別馬路上的袋鼠時(shí)遭遇困難,”他表示,袋鼠的跳躍動作會混淆單眼相機(jī)的視覺處理。

但The Linley Group的Demler并不贊同,他提出的疑問是:“單眼視覺物體偵測與識別算法都已妥善經(jīng)過證實(shí),ImageNet競賽都是以單眼拍攝影像為識別內(nèi)容,這不是很有趣嗎?”他進(jìn)一步表示:“神經(jīng)網(wǎng)絡(luò)推理引擎是分類氣,它們會計(jì)算一個(gè)物體有經(jīng)過預(yù)先訓(xùn)練的概率,如我們所知道的,Uber的系統(tǒng)其實(shí)有偵測到牽著自行車穿越馬路的女性路人,但軟件當(dāng)機(jī)了。”

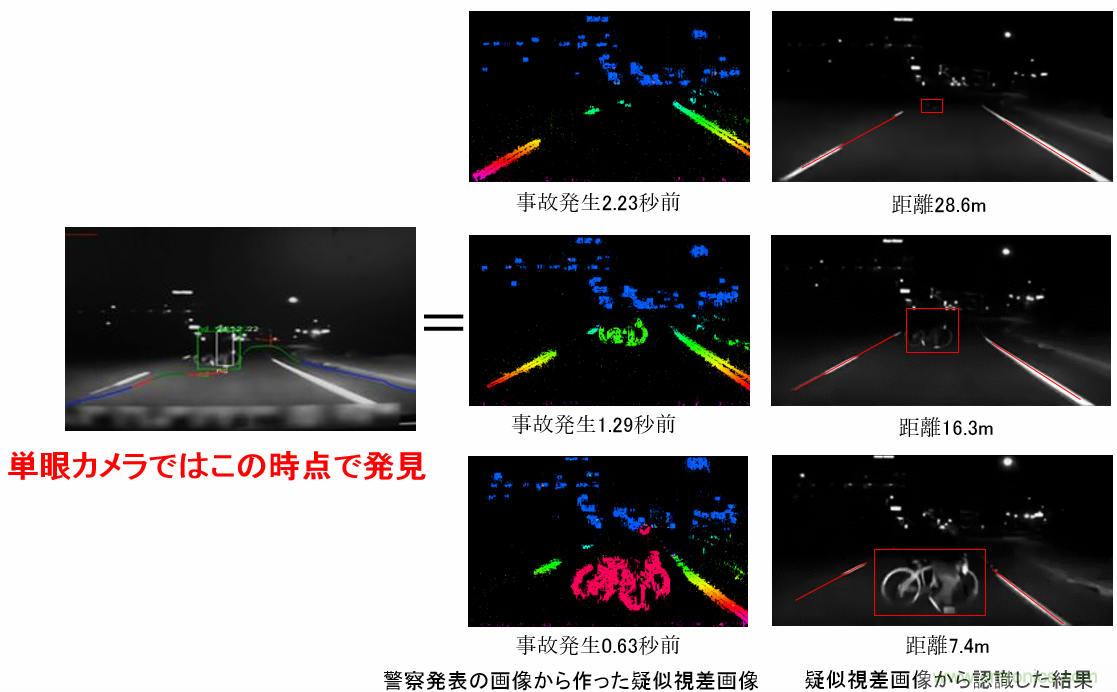

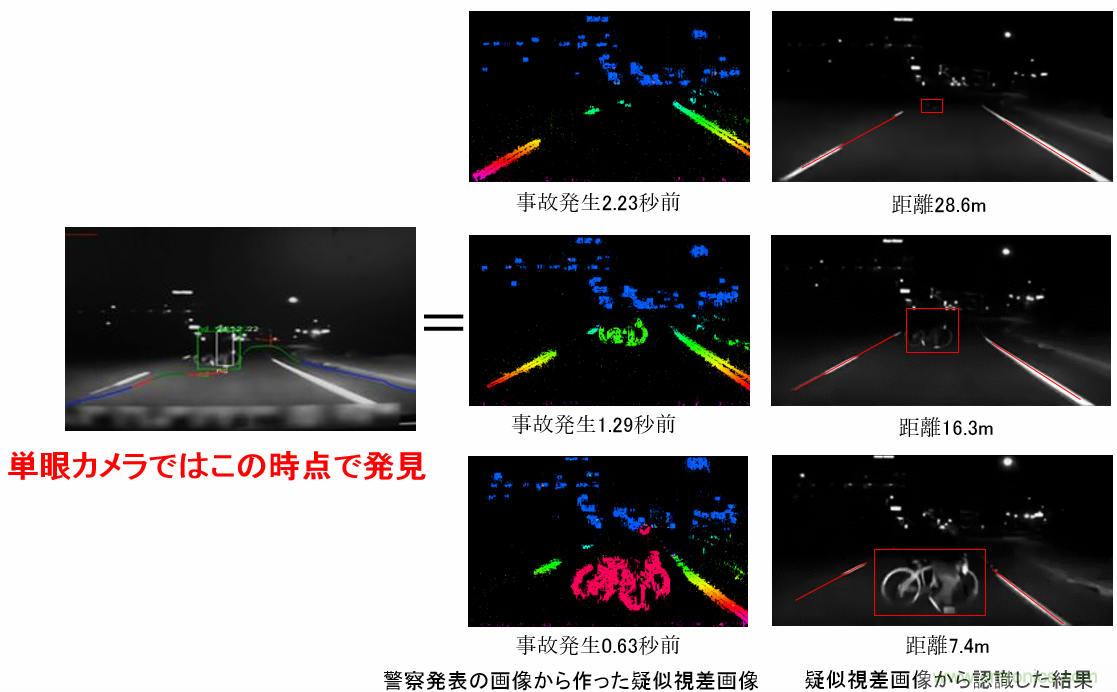

對于Uber自駕車在美國發(fā)生的撞人致死事故,実吉的疑問是Mobileye視覺處理器有沒有在足夠快的時(shí)間內(nèi)偵測到行人。為了證明今日的ADAS技術(shù)性能,Mobileye在來自警方提供之Uber交通事故視頻饋入上執(zhí)行其軟件;英特爾資深副總裁Amnon Shashua在去年3月的一篇部落格文章中表示:“盡管條件不理想,大多數(shù)出現(xiàn)在實(shí)際場景中的高動態(tài)范圍數(shù)據(jù)可能丟失,但在發(fā)生撞擊大約1秒之前能達(dá)成清楚的偵測。”

実吉也有做過一樣的工作,在Uber事故的視頻饋入上執(zhí)行其軟件;根據(jù)他的說法,ITD的智能立體攝像頭能在撞擊發(fā)生前2.23秒偵測到穿越馬路的女性行人。如下圖所示,第一欄是單眼視覺處理器擷取的影像在撞擊前1.29秒偵測到物體,第二欄是ITD的立體視覺擷取到的影像,第三欄則是警方提供的事故發(fā)生當(dāng)時(shí)監(jiān)視錄像。

以不同技術(shù)模擬偵測Uber美國的撞人致死事故 (來源:ITD Lab)

ITD Lab準(zhǔn)備推出其智能立體攝像頭芯片──儲存一組用以處理視差影像數(shù)據(jù)之FPGA程序代碼的ROM芯片──以及包括光學(xué)組件在內(nèi)的參考設(shè)計(jì)開發(fā)板;該公司表示,至少將有一家Tier One廠商正在評估其技術(shù),而実吉表示該方案的功耗是3瓦。

本文轉(zhuǎn)載自電子技術(shù)設(shè)計(jì)。

推薦閱讀: